-

致力于视觉计算与人工智能

热线电话:18998897777

热线电话:18998897777

热线电话:18998897777

热线电话:18998897777

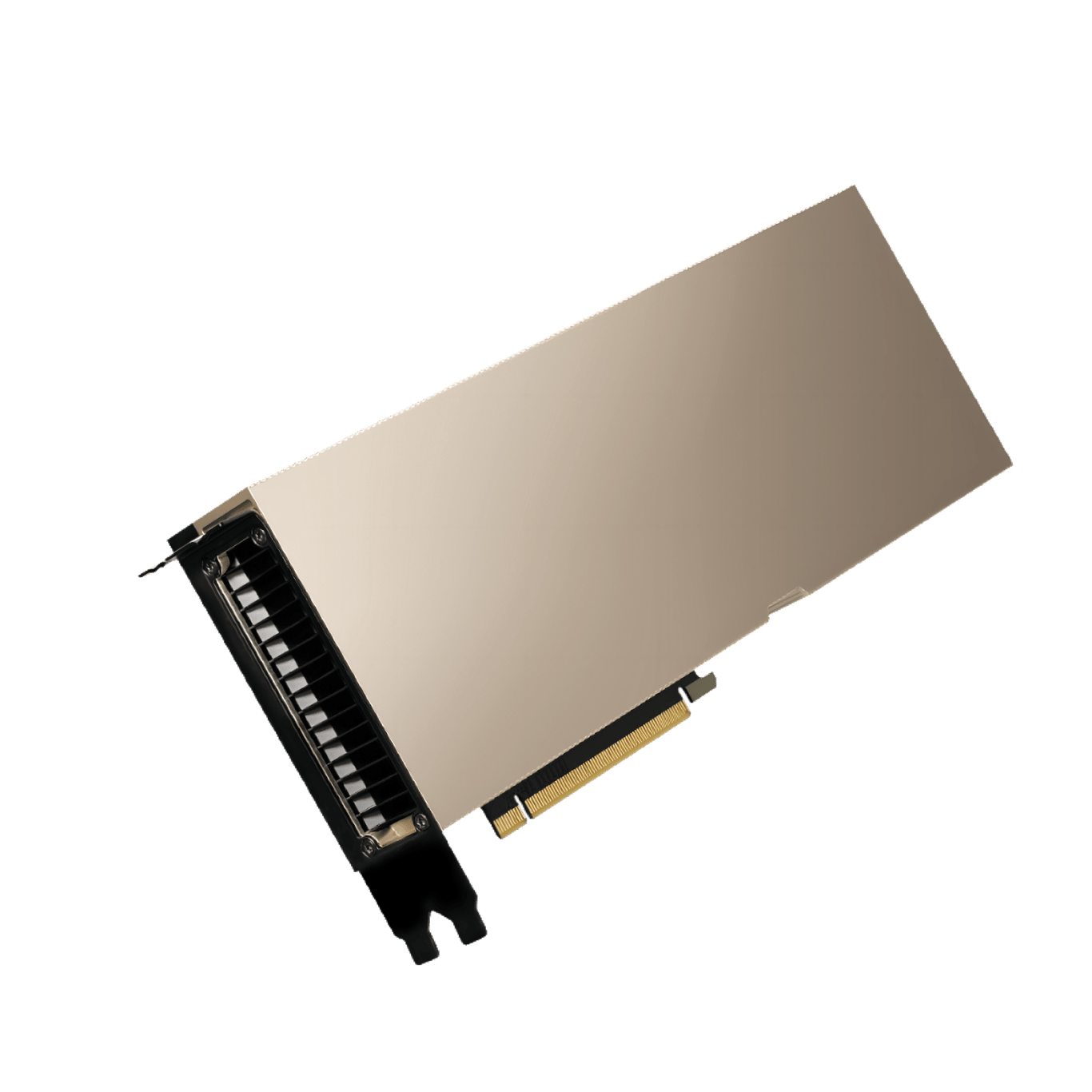

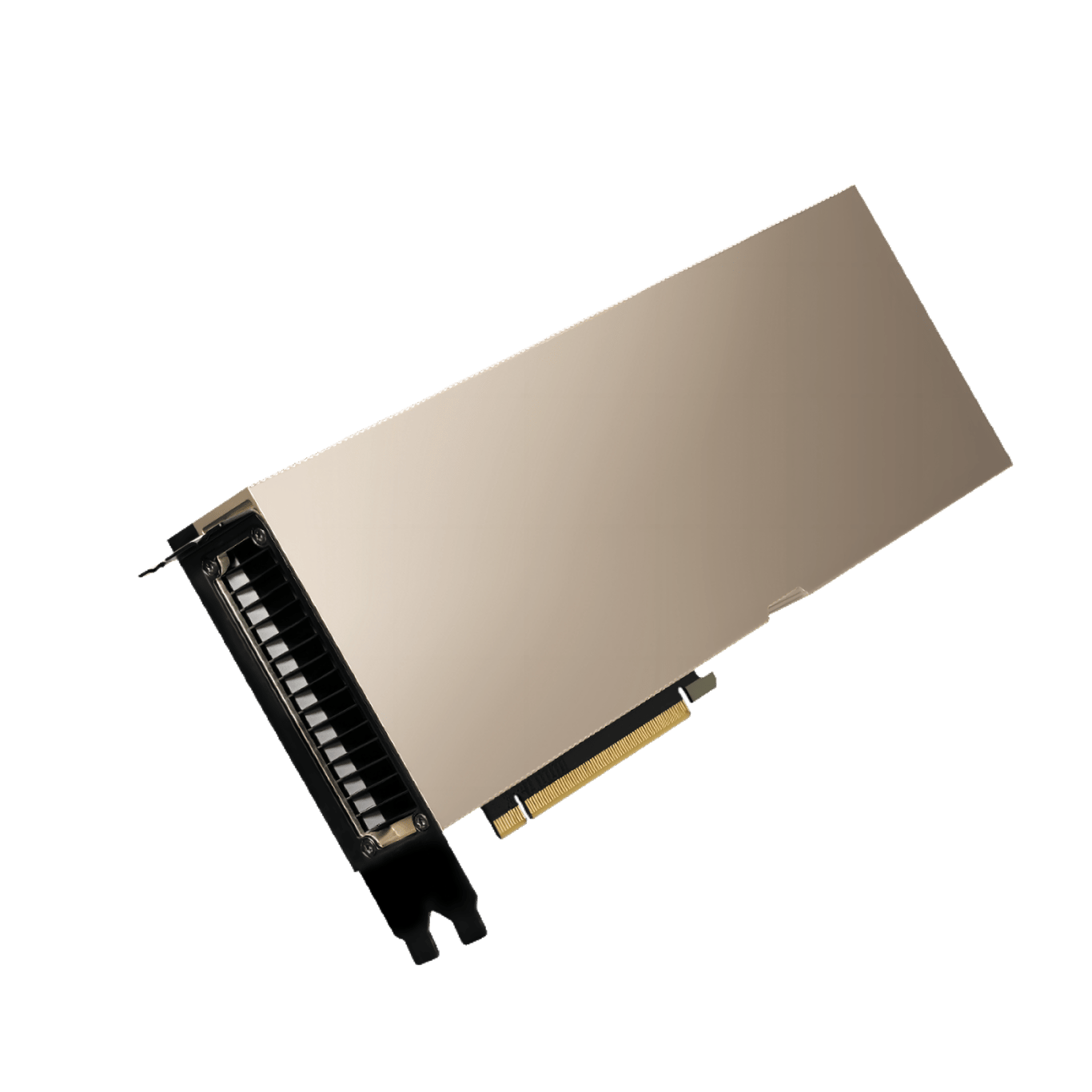

Ada Lovelace 架构:下一代 AI 推理平台

NVIDIA L20 基于革命性的 Ada Lovelace 架构,代表了企业级 GPU 计算的新高度。这一架构专为人工智能推理和主流企业工作负载而优化,为企业提供了强大的计算平台,能够加速现代 AI 应用的部署,创造全新的客户体验,并经济高效地扩展基于人工智能的产品和服务。

L20 采用双插槽全高全长(FHFL)PCIe 4.0 x16 扩展卡设计,功耗为 275W,可轻松集成到标准服务器系统中。其强大的计算能力和高密度存储容量,使其成为数据中心和云服务提供商的理想选择。

第四代 Tensor Core:突破性的 AI 推理性能

NVIDIA L20 搭载第四代 Tensor Core 技术,提供革命性的多精度计算性能。支持 FP32、FP16、INT8、INT4 等多种精度,单精度(FP32)性能高达 59.35 TFLOPS,INT8/FP8 算力达到 239 TOPS。第四代 Tensor Core 支持结构化稀疏和优化的 TF32 格式,显著提升 AI 和数据科学模型训练性能,相比传统 CPU 解决方案,性能提升可达数十倍。

这些先进的 Tensor Core 能够加速各种 AI 工作负载,包括图像识别、自然语言处理、推荐系统、会话式 AI 等复杂的云端推理任务,为企业提供实时、低延时的 AI 服务能力。

48GB GDDR6 ECC 显存:大容量高带宽存储

NVIDIA L20 配备 48GB GDDR6 ECC 显存,提供高达 864GB/s 的内存带宽。ECC(错误校正码)技术确保数据完整性,对于关键业务应用至关重要。大容量显存使得 L20 能够处理大型 AI 模型和复杂的数据集,支持批量推理和模型并行,显著提高吞吐量和效率。

第三代 RT Core:专业级光线追踪性能

L20 集成的第三代 RT Core 大幅增强了光线追踪性能,能够加速产品设计和建筑工程的渲染速度。这使得 L20 不仅适用于 AI 推理,还能胜任专业可视化、3D 建模、计算机辅助工程(CAE)仿真等复杂工作负载。CUDA Core 加速单精度浮点运算,进一步提升 3D 模型开发和 CAE 仿真等工作流程的性能。

多实例 GPU (MIG):灵活的资源分配

NVIDIA L20 支持多实例 GPU(MIG)技术,可将单个 GPU 划分为多个独立的 GPU 实例。每个实例拥有独立的计算、内存和缓存资源,可以分配给不同的用户或工作负载。这一特性使得企业能够更灵活地分配 GPU 资源,提高资源利用率,同时确保不同工作负载之间的隔离性和安全性。

NVIDIA Omniverse Enterprise 支持

L20 完全支持 NVIDIA Omniverse Enterprise,提供强大的 RTX 和 AI 功能。这使得 L20 能够支持扩展现实(XR)、虚拟现实(VR)应用、设计协作和数字孪生等工作负载。企业可以利用 L20 构建沉浸式的虚拟环境,进行实时协作和仿真,推动数字化转型和创新。

应用场景

NVIDIA L20 适用于广泛的 AI 推理和计算应用场景,包括:云端 AI 推理服务、图像识别和计算机视觉、自然语言处理和对话式 AI、推荐系统和个性化服务、3D 建模和 CAD/CAM 应用、科学计算和仿真、数字孪生和虚拟现实、数据中心和云服务提供商等。凭借其高性能、大容量显存和灵活的资源配置能力,L20 成为企业在 AI 推理和主流计算任务中的理想选择。